在人工智能日益融入我们生活的今天,聊天机器人已经成为人们获取信息、解决问题的重要助手。然而,这些看似无所不能的机器人,有时却会在回答中“信口开河”,甚至“造谣”,给用户带来困扰和误导。为了解决这一难题,谷歌DeepMind与斯坦福大学的研究人员近日联手推出了一款基于大语言模型的AI事实核查工具——搜索增强事实评估器(SAFE),旨在确保聊天机器人生成的回答更加准确可信。

AI旋风了解到,SAFE工具的设计初衷是通过对聊天机器人生成的长回复进行事实核查,防止其传播不实信息。该工具通过四个关键步骤实现对回复的精准分析:首先,将聊天机器人的回答分割成单个待核查的内容片段;其次,对这些内容进行必要的修正,以确保其准确性;接着,将修正后的内容与谷歌搜索结果进行对比,以验证其真实性;最后,系统还会检查各个事实与原始问题的相关性,确保回答的针对性和有效性。

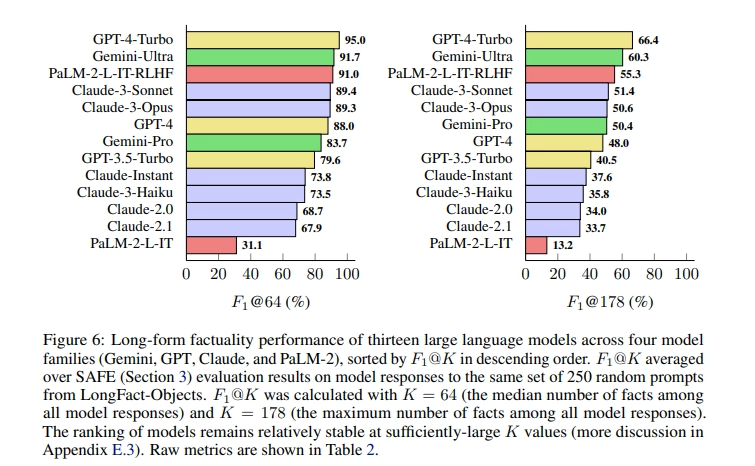

为了确保SAFE工具的性能达到最佳状态,研究人员精心创建了一个包含约16000个事实的数据集LongFact。同时,他们还在来自Claude、Gemini、GPT、PaLM-2等13个大语言模型上对该系统进行了全面测试。令人振奋的是,在对100个有争议的事实进行的重点分析中,SAFE的判定在进一步审查下正确率达到了惊人的76%。

值得一提的是,SAFE工具不仅具备出色的准确性,还具有显著的经济性优势。相较于传统的人工注释方式,SAFE的成本降低了20多倍,极大地提高了事实核查的效率和性价比。这一优势使得SAFE在应对大规模、高频率的事实核查任务时具有更强的竞争力。

AI旋风认为,SAFE工具的推出是人工智能领域的一大进步,它为解决聊天机器人“造谣”问题提供了有效的技术手段。随着人工智能技术的不断发展,我们有理由相信,未来聊天机器人的回答将更加准确、可信,为用户提供更加优质、可靠的服务。

此外,SAFE工具的推出也对于维护网络空间的真实性和可信度具有重要意义。在当今信息爆炸的时代,网络上的虚假信息层出不穷,给人们的判断和决策带来了极大的困扰。SAFE工具的应用将有助于遏制虚假信息的传播,维护网络空间的清朗和秩序。

当然,我们也应该意识到,虽然SAFE工具在事实核查方面取得了显著成效,但它并不能完全替代人工审核。在某些复杂、敏感的问题上,仍需要人类专家的深入分析和判断。因此,我们应该将SAFE工具作为提高事实核查效率和质量的重要辅助手段,而不是完全依赖它来解决所有问题。

总之,谷歌DeepMind与斯坦福大学研究人员推出的AI事实核查工具SAFE为解决聊天机器人“造谣”问题提供了有效的解决方案。它的推出将有助于提高人工智能系统的准确性和可信度,推动人工智能技术的健康发展。我们期待未来更多类似的技术创新能够不断涌现,为人类社会的进步和发展注入新的动力。

渝公网安备50019002504809号

渝公网安备50019002504809号